很多人可能都知道,最近 ChatGPT 是该团队的研究课题 DeepMind。 作为谷歌的一部分,致力于人工智能领域的科学家和学者发现,通过一些技巧,有可能 追踪用户个人数据。 因此,该工具的隐私存在风险,至少在 OpenAI 为其打上补丁之前是这样。 但如何保护自己呢?

保护自己免受 ChatGPT 数据泄露的 3 种方法

不要输入敏感信息

不幸的是,许多人低估的一件事是 聊天机器人会跟踪插入的内容。 如果我们通常分析最低限度的敏感数据(电话号码,而不是收入、支出、银行名称等个人数据),ChatGPT 会将它们存储并保留在内存中。 稍后,正如 DeepMind 实验所强调的那样,这些信息可能会重新出现并产生相当多的问题。

无论是在加载数据时,还是在复制和粘贴某些内容时,都需要 不要输入敏感数据。 如果无法避免插入它们,那么最好执行以下操作: 匿名化工作。 这种方法利用人工智能自动识别个人数据,并通过各种“屏蔽”技术替换敏感信息。

禁用 ChatGPT“聊天历史记录和培训”。

另一件事 poco 已知或至少被低估的问题是 数据训练 通过我们使用 ChatGPT 创建的聊天。 基本上你可以向 OpenAI 聊天机器人发出指示 不要将您编写的内容用作培训过程的一部分,但是对于提高系统的潜力和输出很有用。

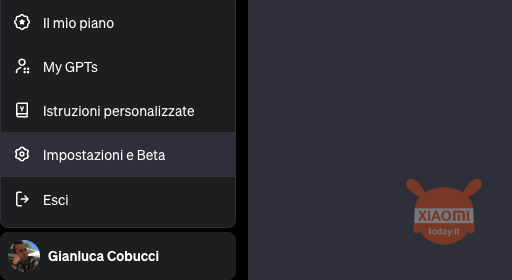

要停用相关历史记录,只需转到左下角的我们的个人资料,然后单击“设置和测试版“,如下图所示:

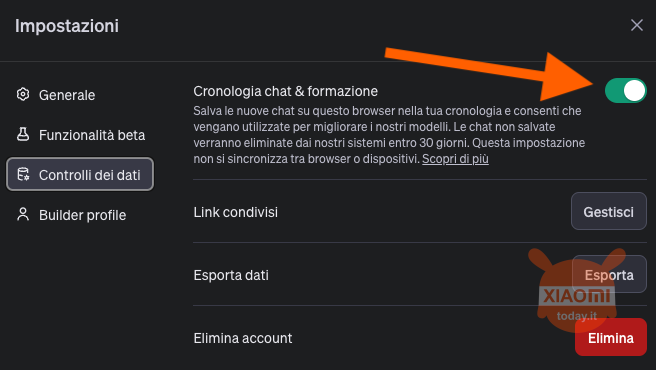

完成此操作后,您将需要转到“数据检查i” 在左侧菜单中,您将看到“聊天和培训历史”。 如果您停用该功能 新的聊天记录不会保存在您的历史记录中,也不会用于训练 通过 ChatGPT:

有一个“但是”。 不幸的是,如果一方面我们会获得更多的隐私,另一方面 我们的聊天记录也将被停用。 从本质上讲,如果 OpenAI 允许我们保护隐私,那么另一方面它又剥夺了一个非常有用的功能。

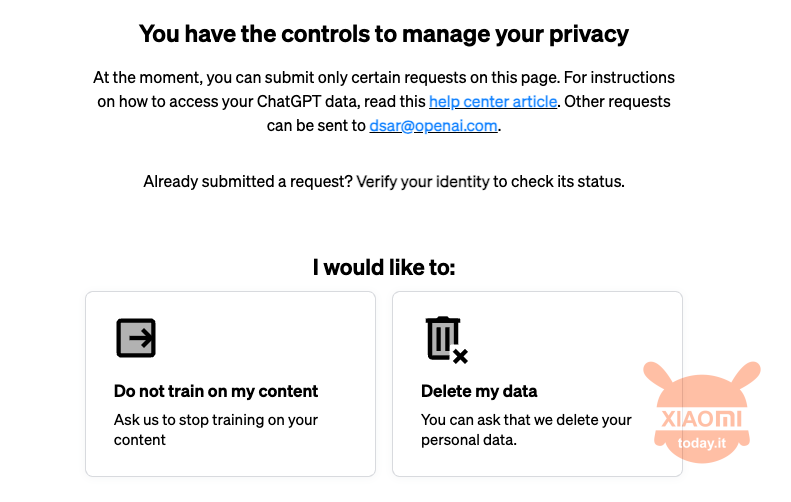

向 OpenAI 请求“隐私请求”

有一种方法可以通过以下方式向 OpenAI 团队提出隐私请求: 这个专门的页面。 该工具允许您向 ChatGPT 发出两个请求:

- 要求不要在您的数据上训练 OpenAI 模型

- 要求从 ChatGPT 中删除您的数据